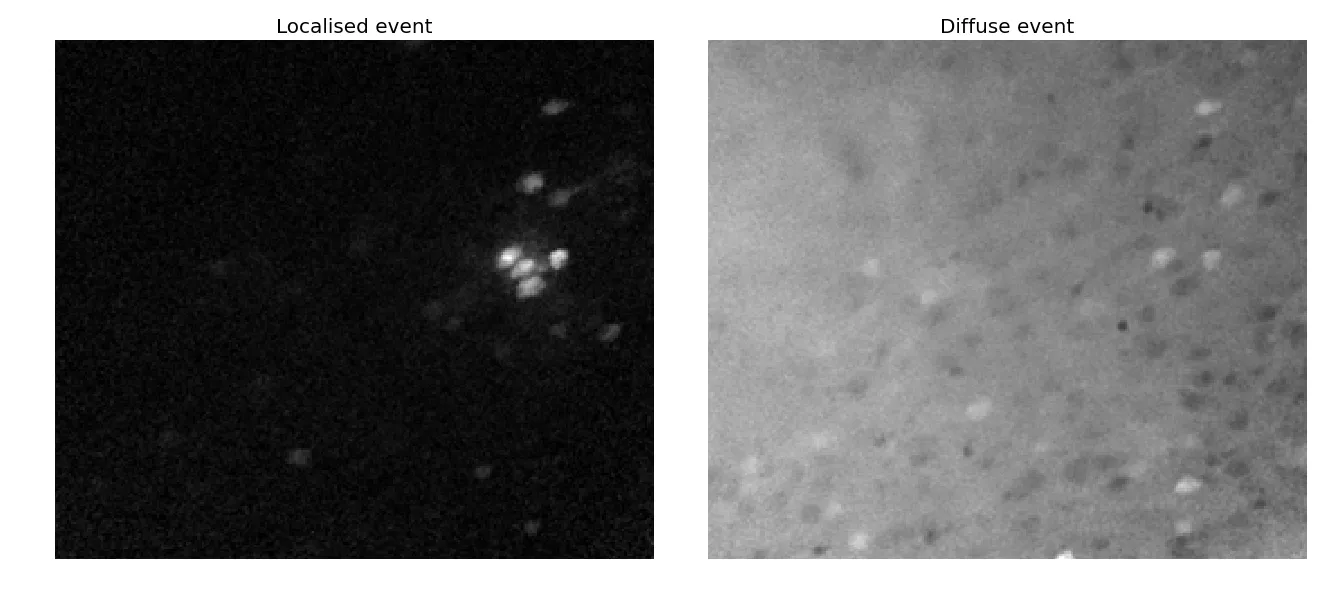

我有一些数据,由视频帧序列组成,代表相对于移动基线随时间变化的亮度变化。在这些视频中,有两种可能发生的“事件” - “本地化”事件,由聚集像素的小组亮度变化组成,以及影响框架大部分像素的污染性“扩散”事件:

我希望能够将亮度中的局部变化与扩散事件分离出来。我打算通过减去适当低通滤波版本的每个帧来实现此目的。为了设计最佳滤波器,我想知道框架的哪些空间频率在扩散和本地事件期间调制,即我想生成一个随时间变化的电影频谱图。

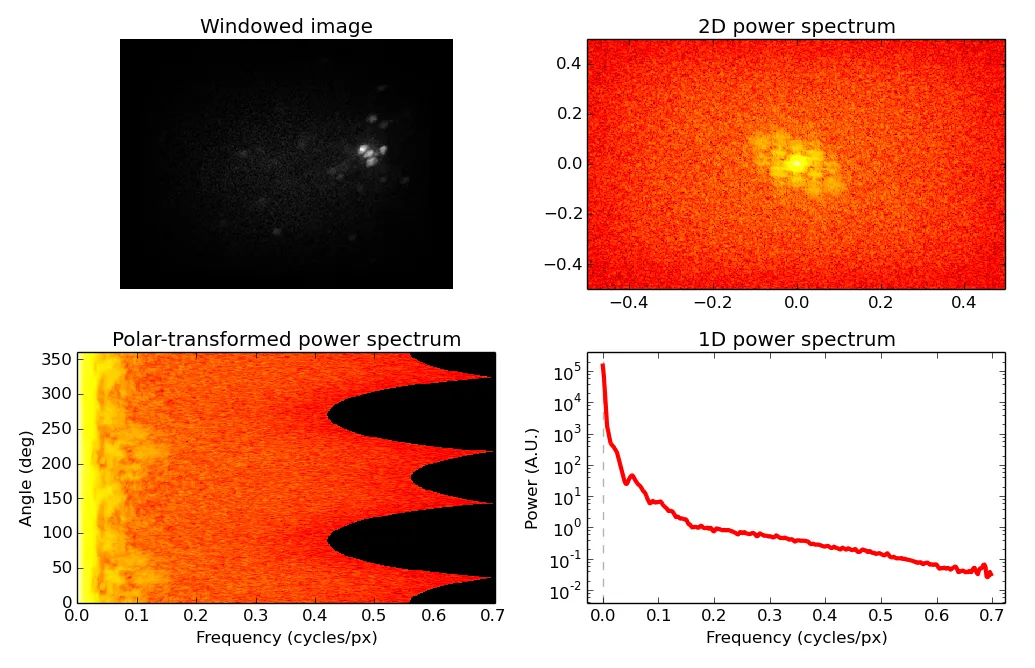

我可以找到很多关于为1D数据(例如音频)生成频谱图的信息,但是我还没有找到关于为2D数据生成频谱图的信息。到目前为止,我尝试过的是从帧的傅里叶变换生成2D功率谱,然后围绕DC分量进行极坐标变换,再沿角度平均得到1D功率谱:

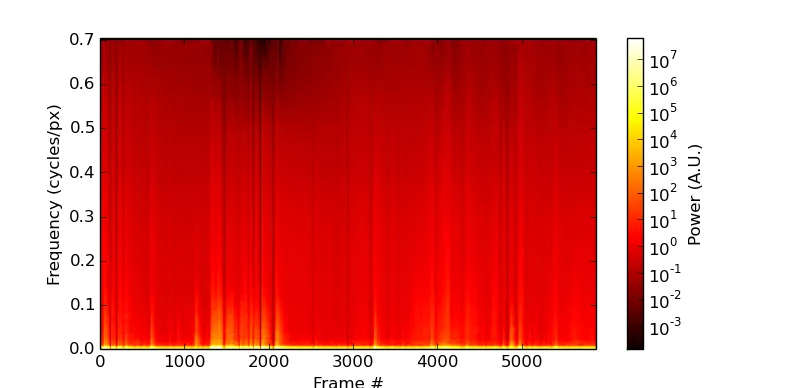

然后将此应用于电影中的每个帧,并生成随时间变化的频谱功率的光栅图:

这个方法看起来合理吗?有没有更“标准”的方法来对2D数据进行谱分析?

以下是我的代码:

import numpy as np

# from pyfftw.interfaces.scipy_fftpack import fft2, fftshift, fftfreq

from scipy.fftpack import fft2, fftshift, fftfreq

from matplotlib import pyplot as pp

from matplotlib.colors import LogNorm

from scipy.signal import windows

from scipy.ndimage.interpolation import map_coordinates

def compute_2d_psd(img, doplot=True, winfun=windows.hamming, winfunargs={}):

nr, nc = img.shape

win = make2DWindow((nr, nc), winfun, **winfunargs)

f2 = fftshift(fft2(img*win))

psd = np.abs(f2*f2)

pol_psd = polar_transform(psd, centre=(nr//2, nc//2))

mpow = np.nanmean(pol_psd, 0)

stdpow = np.nanstd(pol_psd, 0)

freq_r = fftshift(fftfreq(nr))

freq_c = fftshift(fftfreq(nc))

pos_freq = np.linspace(0, np.hypot(freq_r[-1], freq_c[-1]),

pol_psd.shape[1])

if doplot:

fig,ax = pp.subplots(2,2)

im0 = ax[0,0].imshow(img*win, cmap=pp.cm.gray)

ax[0,0].set_axis_off()

ax[0,0].set_title('Windowed image')

lnorm = LogNorm(vmin=psd.min(), vmax=psd.max())

ax[0,1].set_axis_bgcolor('k')

im1 = ax[0,1].imshow(psd, extent=(freq_c[0], freq_c[-1],

freq_r[0], freq_r[-1]), aspect='auto',

cmap=pp.cm.hot, norm=lnorm)

# cb1 = pp.colorbar(im1, ax=ax[0,1], use_gridspec=True)

# cb1.set_label('Power (A.U.)')

ax[0,1].set_title('2D power spectrum')

ax[1,0].set_axis_bgcolor('k')

im2 = ax[1,0].imshow(pol_psd, cmap=pp.cm.hot, norm=lnorm,

extent=(pos_freq[0],pos_freq[-1],0,360),

aspect='auto')

ax[1,0].set_ylabel('Angle (deg)')

ax[1,0].set_xlabel('Frequency (cycles/px)')

# cb2 = pp.colorbar(im2, ax=(ax[0,1],ax[1,1]), use_gridspec=True)

# cb2.set_label('Power (A.U.)')

ax[1,0].set_title('Polar-transformed power spectrum')

ax[1,1].hold(True)

# ax[1,1].fill_between(pos_freq, mpow - stdpow, mpow + stdpow,

# color='r', alpha=0.3)

ax[1,1].axvline(0, c='k', ls='--', alpha=0.3)

ax[1,1].plot(pos_freq, mpow, lw=3, c='r')

ax[1,1].set_xlabel('Frequency (cycles/px)')

ax[1,1].set_ylabel('Power (A.U.)')

ax[1,1].set_yscale('log')

ax[1,1].set_xlim(-0.05, None)

ax[1,1].set_title('1D power spectrum')

fig.tight_layout()

return mpow, stdpow, pos_freq

def make2DWindow(shape,winfunc,*args,**kwargs):

assert callable(winfunc)

r,c = shape

rvec = winfunc(r,*args,**kwargs)

cvec = winfunc(c,*args,**kwargs)

return np.outer(rvec,cvec)

def polar_transform(image, centre=(0,0), n_angles=None, n_radii=None):

"""

Polar transformation of an image about the specified centre coordinate

"""

shape = image.shape

if n_angles is None:

n_angles = shape[0]

if n_radii is None:

n_radii = shape[1]

theta = -np.linspace(0, 2*np.pi, n_angles, endpoint=False).reshape(-1,1)

d = np.hypot(shape[0]-centre[0], shape[1]-centre[1])

radius = np.linspace(0, d, n_radii).reshape(1,-1)

x = radius * np.sin(theta) + centre[0]

y = radius * np.cos(theta) + centre[1]

# nb: map_coordinates can give crazy negative values using higher order

# interpolation, which introduce nans when you take the log later on

output = map_coordinates(image, [x, y], order=1, cval=np.nan,

prefilter=True)

return output