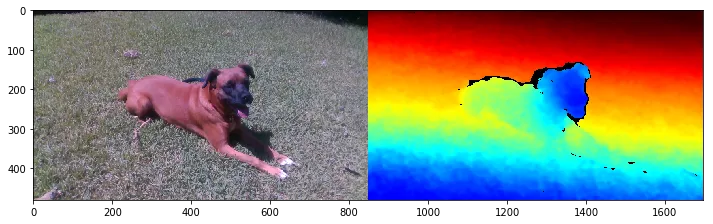

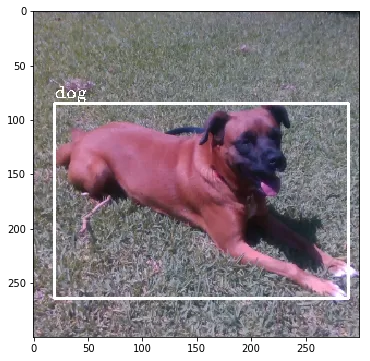

我正在使用深度学习(Tensorflow目标检测)和Real Sense D425相机开发一个狗的检测系统。我使用Intel(R) RealSense(TM) ROS包装器从相机中获取图像,执行"roslaunch rs_rgbd.launch"命令并订阅"/camera/color/image_raw"主题以获取RGB图像。利用这个图像和目标检测库,我能够推断出在图像中狗的位置(20fps), 并得到一个框来表示它的位置 (xmin,xmax,ymin,ymax)。

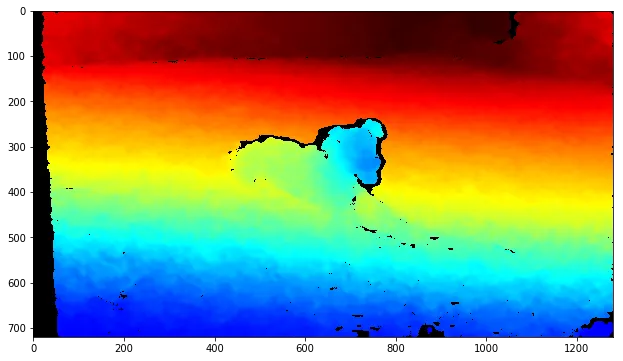

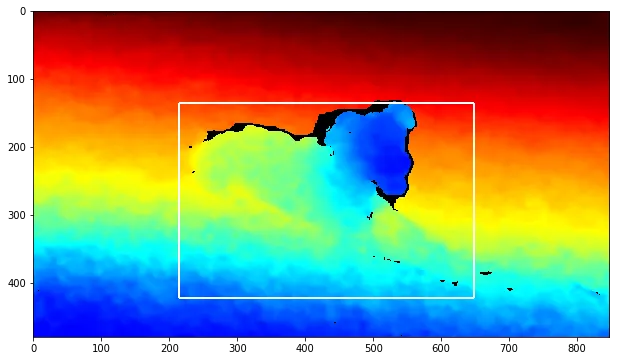

我想剪辑点云信息与目标检测信息(xmin,xmax,ymin,ymax),并确定狗是否远离或靠近相机。我想使用RGB图像和点云之间的像素级对齐信息。

请问如何实现此功能?是否有相应的主题?

谢谢!

我想剪辑点云信息与目标检测信息(xmin,xmax,ymin,ymax),并确定狗是否远离或靠近相机。我想使用RGB图像和点云之间的像素级对齐信息。

请问如何实现此功能?是否有相应的主题?

谢谢!