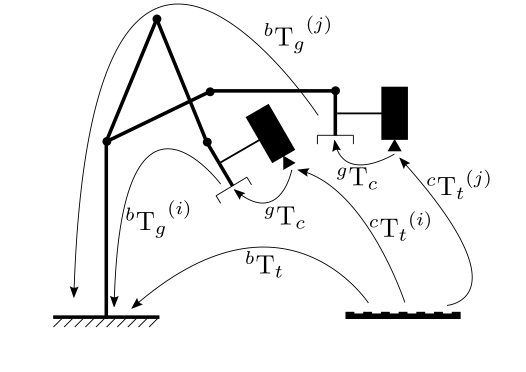

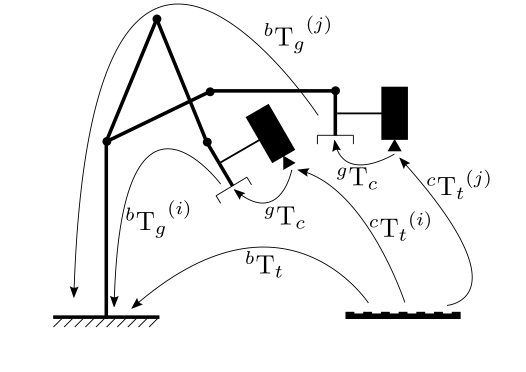

我有一个设置,其中一台(2D)相机安装在机器人臂的末端执行器上 - 类似于OpenCV 文档:

我想校准相机并找到从相机到末端执行器的转换。 我已经使用这个OpenCV指南 相机校准 对相机进行了校准,使用棋盘图获得未畸变的图像。

我想校准相机并找到从相机到末端执行器的转换。 我已经使用这个OpenCV指南 相机校准 对相机进行了校准,使用棋盘图获得未畸变的图像。

我的问题是找到从相机到末端执行器的变换。我看到OpenCV有一个函数calibrateHandEye(),应该可以实现这个目标。我已经有了“gripper2base”向量,但缺少“target2cam”向量。这是否应该基于棋盘格方块的大小或者我还缺少什么?任何指导都将不胜感激。

我想校准相机并找到从相机到末端执行器的转换。 我已经使用这个OpenCV指南 相机校准 对相机进行了校准,使用棋盘图获得未畸变的图像。

我想校准相机并找到从相机到末端执行器的转换。 我已经使用这个OpenCV指南 相机校准 对相机进行了校准,使用棋盘图获得未畸变的图像。我的问题是找到从相机到末端执行器的变换。我看到OpenCV有一个函数calibrateHandEye(),应该可以实现这个目标。我已经有了“gripper2base”向量,但缺少“target2cam”向量。这是否应该基于棋盘格方块的大小或者我还缺少什么?任何指导都将不胜感激。