我正在尝试使用OpenCV,通过Python将平面YUV 4:2:0图像转换为RGB,并且在理解如何格式化数组以传递给函数方面遇到了困难。我有所有三个通道作为单独的数组,并尝试将它们合并以供

上面的代码试图以列为单位交错U和V信息。

我还尝试使用以下方法将U和V通道信息放入

这是一幅由libav从另一个程序中获取的视频帧图像,其格式为

以下是灰度显示的示例图像的yuv通道: Y通道:

cv2.cvtColor使用。我正在使用cv2.cvtColor(yuv_array, cv2.COLOR_YUV420p2RGB)。我了解到yuv_array应该比原始图像高1.5倍(这就是使用cv2.COLOR_RGB2YUV_YV12从得到的yuv数组的样子),并且我应该将UV分量放入yuv_array的底部一半,将Y通道放入数组的顶部。

我似乎无法弄清楚U和V通道应该如何在该数组的底部格式化。我已经尝试过交错它们并将它们都放在那里。对于两种方法,我都尝试先放U再放V,也尝试了反过来。所有方法都会导致结果图像中出现伪影。这是我的代码和一个示例图像:

import os

import errno

import numpy as np

import cv2

fifo_names = ["/tmp/fifos/y_fifo", "/tmp/fifos/u_fifo", "/tmp/fifos/v_fifo"]

#teardown; delete fifos

import signal, sys

def cleanup_exit(signal, frame):

print ("cleaning up!")

for fifo in fifo_names:

os.remove(fifo)

sys.exit(0)

signal.signal(signal.SIGINT, cleanup_exit)

signal.signal(signal.SIGTERM, cleanup_exit)

#make fifos

for fifo in fifo_names:

try:

os.mkfifo(fifo);

except OSError as oe:

if oe.errno == errno.EEXIST:

os.remove(fifo)

os.mkfifo(fifo)

else:

raise()

#make individual np arrays to store Y,U, and V channels

#we know the image size beforehand -- 640x360 pixels

yuv_data = []

frame_size = []

fullsize = (360, 640)

halfsize = (180, 320)

for i in range(len(fifo_names)):

if (i == 0):

size = fullsize

else:

size = halfsize

yuv_data.append(np.empty(size, dtype=np.uint8));

frame_size.append(size)

#make array that holds all yuv data for display with cv2

all_yuv_data = np.empty((fullsize[0] + halfsize[0], fullsize[1]), dtype=np.uint8)

#continuously read yuv images from fifos

print("waiting for fifo to be written to...")

while True:

for i in range(len(fifo_names)):

fifo = fifo_names[i]

with open(fifo, 'rb') as f:

print("FIFO %s opened" % (fifo))

all_data = b''

while True:

data = f.read()

print("read from %s, len: %d" % (fifo,len(data)))

if len(data) == 0: #then the fifo has been closed

break

else:

all_data += data

yuv_data[i] = np.frombuffer(all_data, dtype=np.uint8).reshape(frame_size[i])

#stick all yuv data in one buffer, interleaving columns

all_yuv_data[0:fullsize[0],0:fullsize[1]] = yuv_data[0]

all_yuv_data[fullsize[0]:,0:fullsize[1]:2] = yuv_data[1]

all_yuv_data[fullsize[0]:,1:fullsize[1]:2] = yuv_data[2]

#show each yuv channel individually

cv2.imshow('y', yuv_data[0])

cv2.imshow('u', yuv_data[1])

cv2.imshow('v', yuv_data[2])

#convert yuv to rgb and display it

rgb = cv2.cvtColor(all_yuv_data, cv2.COLOR_YUV420p2RGB);

cv2.imshow('rgb', rgb)

cv2.waitKey(1)

上面的代码试图以列为单位交错U和V信息。

我还尝试使用以下方法将U和V通道信息放入

all_yuv_data数组中: #try back-to-back

all_yuv_data[0:fullsize[0],0:fullsize[1]] = yuv_data[0]

all_yuv_data[fullsize[0]:,0:halfsize[1]] = yuv_data[1]

all_yuv_data[fullsize[0]:,halfsize[1]:] = yuv_data[2]

这是一幅由libav从另一个程序中获取的视频帧图像,其格式为

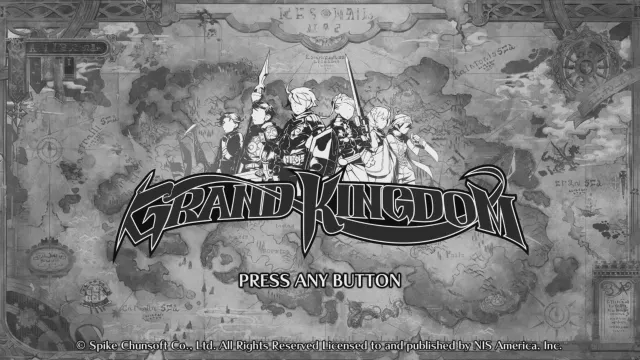

AV_PIX_FMT_YUV420P,被描述为“平面YUV 4:2:0,12bpp,(每2x2个Y样本对应1个Cr和Cb样本)”。以下是灰度显示的示例图像的yuv通道: Y通道:

U通道:

V频道:

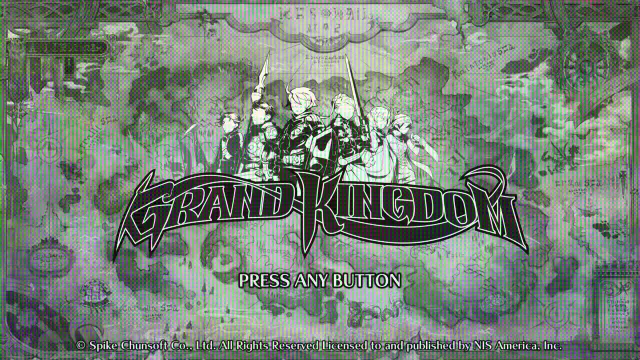

以下是使用上述交错方法得到的对应RGB转换结果(使用“背靠背”方法时也会出现类似伪影):

带有伪影的RGB图像:

all_yuv_data中放置u和v通道信息?

Mark Setchell编辑后的内容:

我认为期望的结果是:

{ convert y.png -depth 8 gray:- ; convert u.png -depth 8 gray:- ; convert v.png -depth 8 gray:- ; } | convert -depth 8 -size 640x360 yuv:- result.jpg。 - Mark Setchell