在Keras中,当我像这样创建一个LSTM对象

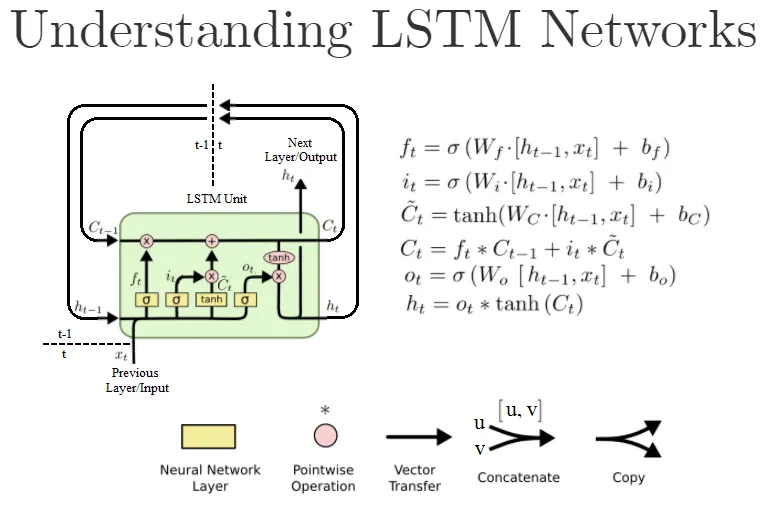

LSTM(units=N, ...),我是否实际上创建了N个这样的LSTM单元?还是它是LSTM单元内部的“神经网络”层的大小,即公式中的W?或者是其他什么?为了背景,我是基于这个示例代码工作的。

以下是文档:https://keras.io/layers/recurrent/ 它说:

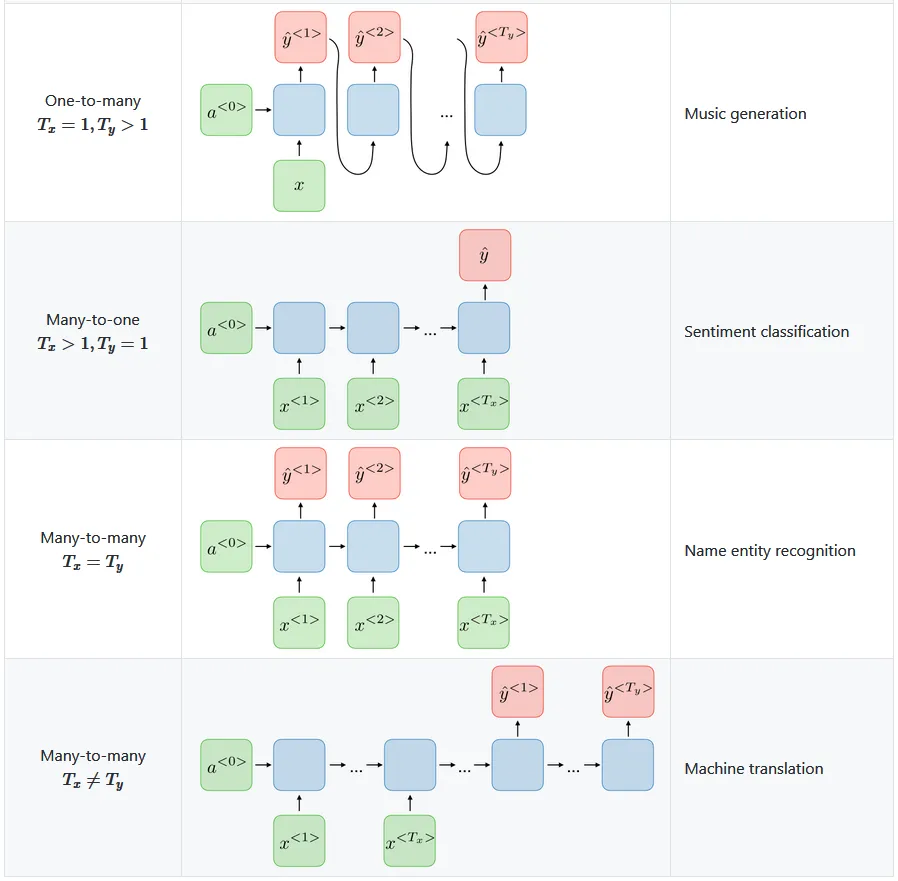

这让我想到它是来自Keras LSTM“层”对象的输出数量。这意味着下一层将有N个输入。这是否意味着在LSTM层中实际存在N个这些LSTM单元,或者可能只运行一个LSTM单元进行N次迭代,从h[t-N]到h[t]输出N个这样的h[t]值?units:正整数,输出空间的维度。

如果它仅定义了输出数量,那么输入是否仍然可以只有一个,还是我们必须手动创建滞后的输入变量x[t-N]到x[t],为每个由units=N参数定义的LSTM单元创建一个?

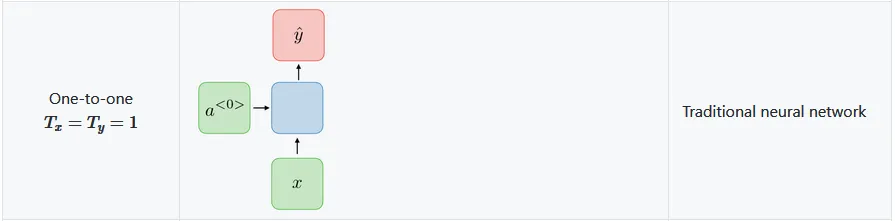

当我写这篇文章时,我想到了return_sequences参数的作用。如果设置为True,则所有N个输出都将传递到下一层,而如果设置为False,则仅将最后一个h[t]输出传递到下一层。我是对的吗?