什么是机器学习中的归纳偏置?为什么它是必要的?

机器学习中的归纳偏差是什么?

2

每个具有超越训练数据的泛化能力的机器学习算法都有某种归纳偏置,这些是模型为学习目标函数和在训练数据之外进行泛化所作出的假设。

例如,在线性回归中,模型假定输出或因变量与自变量之间存在线性关系(通过权重)。这是该模型的一种归纳偏置。

3

什么是归纳偏见?

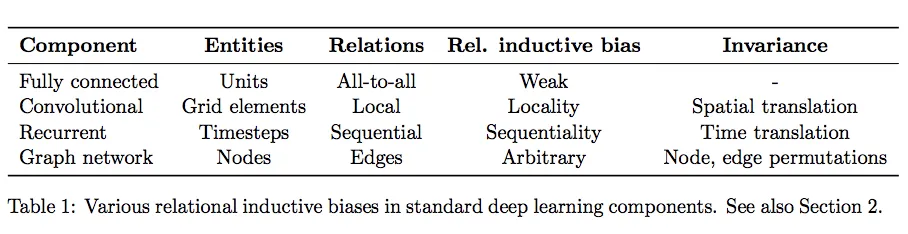

机器学习中的每一个设计选择都代表了某种形式的归纳偏见。在本答案中,我将参考《关系归纳偏置、深度学习和图网络》(Battaglia等人,2018)进行解释。

归纳偏见允许学习算法在不依赖观察数据的情况下优先考虑一种解决方案(或解释)而非其他[...]归纳偏见可以表达关于数据生成过程或解决方案空间的假设。

深度学习中的例子

具体来说,深度学习中层的组合提供了一种类型的关系归纳偏见:分层处理。 层的类型施加了进一步的关系归纳偏见:

更一般地,深度学习中使用的非关系归纳偏见包括:

- 激活非线性性,

- 权重衰减,

- 随机失活,

- 批量和层标准化,

- 数据增强,

- 训练计划,

- 优化算法,

- 任何对学习轨迹有限制的事物。

深度学习之外的例子

在贝叶斯模型中,归纳偏置通常通过选择和参数化先验分布来表达。将Tikhonov正则化惩罚加入损失函数意味着假定更简单的假设更可能发生。

结论

归纳偏置越强,样本效率越高--这可以用偏差-方差折衷来解释。许多现代深度学习方法遵循“端到端”的设计理念,强调最小的a priori表示和计算假设,这就解释了它们为什么往往需要如此大量的数据。另一方面,有很多研究将更强的关系归纳偏置融入深度学习架构中,例如使用图网络。

关于“归纳”一词的旁注

在哲学中,归纳推理指从具体观察中推广出结论。这是演绎推理的反面,演绎推理指从一般观念到结论的专业化。

1

归纳偏置是学习者用来预测未曾遇到的输入结果的一系列假设。

根据Tom Mitchell的定义,

学习者的归纳偏置是一组附加假设,足以将其归纳推理视为演绎推理。

我并不能完全理解上述定义,因此我查阅了维基百科,并能用通俗易懂的语言总结出该定义。

在给定数据集的情况下,应选择哪种学习模型(=归纳偏差)?

归纳偏差对任务有一些先前的假设。没有一种偏见适用于所有问题,已经进行了大量的研究努力来自动发现归纳偏差。

以下是机器学习算法中常见的归纳偏差列表。

最大条件独立性:如果假设可以用贝叶斯框架表示,请尝试最大化条件独立性。这是朴素贝叶斯分类器中使用的偏差。

最小交叉验证误差:当尝试在假设之间进行选择时,请选择具有最低交叉验证误差的假设。尽管交叉验证可能看起来没有偏见,但“无免费午餐”定理表明交叉验证必须具有偏见。

最大间隔:在绘制分界线时,请尝试最大化边界的宽度。这是支持向量机中使用的偏差。假设不同类别倾向于被宽广的边界分开。

最小描述长度:在形成假设时,请尝试最小化假设的描述长度。假设简单则更可能为真。参见奥卡姆剃刀。

最小特征: 除非有充分的证据表明某个特征有用,否则应将其删除。这是特征选择算法背后的假设。

最近邻居: 假设特征空间中一个小邻域内的大多数案例都属于同一类。对于一个类别未知的案例,猜测它属于其直接邻居中占多数的类别。这是k最近邻算法中使用的偏见。该假设是靠近彼此的案例往往属于相同的类别。

更多信息请参见: 归纳偏见 - 如何在新数据上进行泛化

4

归纳偏差的例子包括:

- 线性回归:Y在X中呈线性变化(用X的参数表示)。 - 逻辑回归:存在一个可分离负/正示例的超平面。 - 神经网络:简单来说,Y是X的某个非线性函数(非线性取决于激活函数、拓扑等)。

归纳偏差是指模型通过观察数据点之间的关系自学习一组假设,以制定广义模型。当面对实时测试数据时,预测的准确性将会提高。

例如:

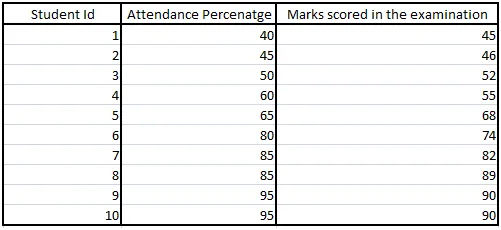

我们考虑一个回归模型,以出勤率作为自变量来预测学生的分数-

在这里,模型将假设出勤百分比与学生分数之间存在线性关系。这种假设仅仅是归纳偏见。将来,如果任何新的测试数据应用到模型中,那么该模型将尝试根据其通过此训练数据所学习的知识来预测分数。在它第一次看到测试数据之前,线性是该模型具有的重要信息(假设)。因此,该模型的归纳偏见是独立变量和因变量之间线性关系的假设。

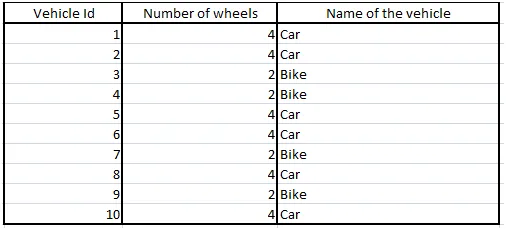

考虑另一个例子,我们有支持向量机模型,根据它作为自变量的车轮数量来分类车辆是汽车还是摩托车。 在这里,该模型将尝试通过最大化决策边界之间的宽度来增加两个类之间的距离。这种学习将被用作测试数据的假设,这是该模型的归纳偏差。

同样地,我们可以考虑许多机器学习示例,涉及许多算法的特性,如:

- K近邻 - 假设新数据点的类别属于K个最近邻居类别中的大多数。 - 关联规则 - 假设具有高置信度值的2个项目通常会被客户一起购买。 - 时间序列分析 - 假设当时间依赖变量的内在值从下方穿过移动平均线到上方时,时间依赖变量的值随时间增加的可能性会增加。

例如,在线性回归中,该模型意味着输出或因变量与自变量呈线性关系(在权重中)。这是模型的归纳偏差。希望这个答案能帮到你。

我认为归纳偏置是一组假设,人们可以从中更准确地预测不在我们数据集中的输入。模型必须具有一定的归纳偏置,因为只有这样,模型才能对更多的数据更有用。模型的目标是适应大部分数据,而不仅仅是样本数据。因此,归纳偏置非常重要。

Maximum conditional independence in Bayesian framework

Minimum cross-validation error

Maximum margin in Support Vector Machine (SVM)

Minimum description length (Based on Occam’s razor principle that argues simpler hypotheses are more likely to be true)

Minimum features (Unless there is good evidence that a feature is useful, it should be deleted)

Nearest neighbors in clustering

Model ensemble in boosting algorithms (using multiple additive classifiers to obtain better predictive performance).

原文链接