我们知道BERT的令牌最大长度限制为512,因此如果一篇文章的长度超过了512个令牌,比如文本中有10000个令牌,那么如何使用BERT呢?

- 你可以将较长的文本截断,仅使用前512个标记。原始的BERT实现(可能也包括其他实现)会自动截断较长的序列。对于大多数情况来说,这个选项已经足够了。

- 你可以将文本分成多个子文本,对每个子文本进行分类,然后将结果组合在一起(例如选择被大多数子文本预测为某个类别的类别)。这个选项显然更加耗费资源。

- 你甚至可以像第二个选项一样,将每个子文本的输出标记馈送到另一个网络中(但你将无法微调),具体请参见此讨论。

3

有针对长文档分析的新研究。如您所询问的,类似于预训练变压器BERT的一个新的预训练变压器Longformer最近由ALLEN NLP发布(https://arxiv.org/abs/2004.05150)。请查看此链接以获取论文。

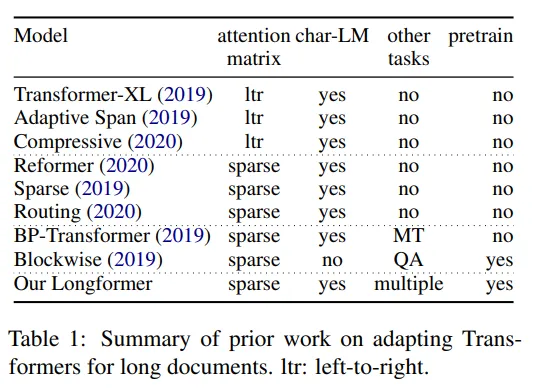

相关工作部分还提到了一些关于长序列的先前工作。也可以在谷歌上搜索这些工作。我建议至少要阅读Transformer XL (https://arxiv.org/abs/1901.02860)。据我所知,这是长序列的最初模型之一,因此在进入“Longformers”之前,使用它作为基础会很有帮助。

- Reformer:将Transformer的建模能力与可以有效执行长序列的架构相结合。 - Longformer:具有线性缩放序列长度的注意机制,使其易于处理数千个标记或更长的文档。

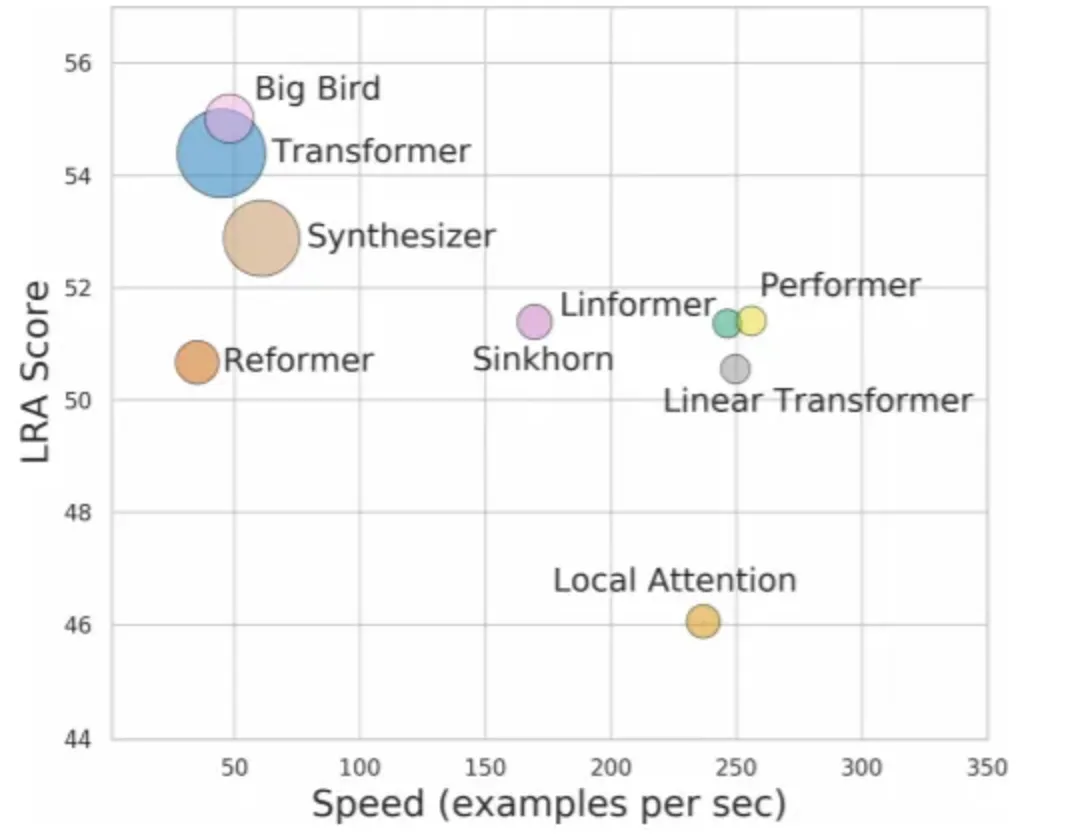

另外还有8种最近提出的高效Transformer模型,包括Sparse Transformers(Child等,2019)、Linformer(Wang等,2020)、Sinkhorn Transformers(Tay等,2020b)、Performers(Choromanski等,2020b)、Synthesizers(Tay等,2020a)、Linear Transformers(Katharopoulos等,2020)和BigBird(Zaheer等,2020)。

来自Google Research和DeepMind作者的paper试图基于“聚合指标”对这些Transformer进行比较。 他们还建议说,在分类任务方面,长格式器的表现比改革者更好。

1

我最近(2021年4月)发表了一篇关于这个主题的论文,你可以在arXiv上找到它 (https://arxiv.org/abs/2104.07225)。表格1允许查看有关问题的先前方法,整篇手稿是关于长文本分类并提出了一种名为Text Guide的新方法。这种新方法声称相对于 paper (https://arxiv.org/abs/1905.05583) 中提到并使用的朴素和半朴素文本选择方法,可以提高性能。

简而言之,关于您的选项:

低计算成本:使用朴素/半朴素的方法选择原始文本实例的一部分。例如选择前n个标记,或者编译一个由原始文本实例的开头和结尾组成的新文本实例。

中高计算成本:使用最近的变形金刚模型(如Longformer),其具有4096个令牌限制而不是512个。在某些情况下,这将允许覆盖整个文本实例,并且修改后的注意机制会减少计算成本。

高计算成本:将文本实例分成适合像BERT这样的模型的块,每个部分单独部署模型,然后连接生成的向量表示。

现在,在我最近发表的论文中提出了一种名为“Text Guide”的新方法。Text Guide是一种文本选择方法,与天真或半天真的截断方法相比,可以实现更好的性能。作为一种文本选择方法,Text Guide不会干扰语言模型,因此它可用于改进具有“标准”令牌限制(例如变压器模型的512个令牌)或“扩展”限制(例如Longformer模型的4096个令牌)的模型的性能。总之,Text Guide是一种低计算成本的方法,可以改善性能,优于天真和半天真的截断方法。如果文本实例超过专门为长文本分类开发的模型的限制,例如Longformer(4096个令牌),它还可以改善它们的性能。

- 将所有“短”BERT串联在一起(最多包含512个标记)

- 构建一个真正的长BERT(CogLTX、Blockwise BERT、Longformer、Big Bird)

这篇论文《防御神经网络虚假新闻》(https://arxiv.org/abs/1905.12616)采用了一种方法。

他们的生成模型输出1024个标记,并且想要使用BERT来区分人类和机器生成的结果。他们通过初始化512个嵌入并在微调BERT时进行训练,扩展了BERT使用的序列长度。

2

在下载BERT模型到您的内核时,可以使用配置中的max_position_embeddings参数。使用此参数,您可以选择512、1024或2048作为最大序列长度。

max_position_embeddings(int,可选,默认为512)-此模型可能使用的最大序列长度。通常将其设置为较大的值以防万一(例如512或1024或2048)。

1

原文链接