所以,我正在尝试理解支持向量机算法的工作原理,但我就是无法弄清楚如何将一些数据集转换为在n维平面上具有数学意义的点,从而通过一个超平面将这些点分离和分类。

这里有一个示例链接,他们试图将老虎和大象的图片分类,他们说:“我们将它们数字化为100x100像素的图像,因此我们在n维平面上拥有x,在这里n=10,000”,但我的问题是他们如何将实际上仅表示一些颜色代码的矩阵转换为在数学上具有意义的点,以便将它们分类为2类?

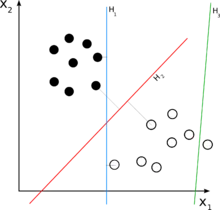

也许有人可以用2D的例子来解释,因为我看到的任何图形表示都是2D的,而不是nD。