我尝试了不同的解决方案(例如this one),但是得到的颜色与实际图像略有不同。我猜这是因为图像只有RGB,而不是RGBA。这可能会有问题吗?

相关问题:如果UIImage具有contentMode = .scaleAspectFill,我是否需要重新计算图像,还是可以直接使用imageView.image?

编辑:

我尝试使用此扩展:

extension CALayer {

func getPixelColor(point: CGPoint) -> CGColor {

var pixel: [CUnsignedChar] = [0, 0, 0, 0]

let colorSpace = CGColorSpaceCreateDeviceRGB()

let bitmapInfo = CGBitmapInfo(rawValue: CGImageAlphaInfo.premultipliedLast.rawValue)

let context = CGContext(data: &pixel, width: 1, height: 1, bitsPerComponent: 8, bytesPerRow: 4, space: colorSpace, bitmapInfo: bitmapInfo.rawValue)

context!.translateBy(x: -point.x, y: -point.y)

self.render(in: context!)

let red: CGFloat = CGFloat(pixel[0]) / 255.0

let green: CGFloat = CGFloat(pixel[1]) / 255.0

let blue: CGFloat = CGFloat(pixel[2]) / 255.0

let alpha: CGFloat = CGFloat(pixel[3]) / 255.0

let color = UIColor(red:red, green: green, blue:blue, alpha:alpha)

return color.cgColor

}

}

但对于一些图像来说,似乎坐标系被翻转了,对于其他图像,我得到的值非常错误...我在这里缺少什么吗?

编辑2:

我尝试使用这些图像:

https://dl.dropboxusercontent.com/u/119600/gradient.png https://dl.dropboxusercontent.com/u/119600/gradient@2x.png

但是我得到了错误的值。它们嵌入在一个UIImageView 中,但我转换了坐标:private func convertScreenPointToImage(point: CGPoint) -> CGPoint {

let widthMultiplier = gradientImage.size.width / UIScreen.main.bounds.width

let heightMultiplier = gradientImage.size.height / UIScreen.main.bounds.height

return CGPoint(x: point.x * widthMultiplier, y: point.y * heightMultiplier)

}

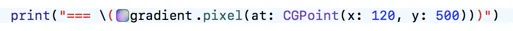

这一个

当在iPhone 7模拟器上运行时,给我=== Optional((51, 76, 184, 255)),这是不正确的...