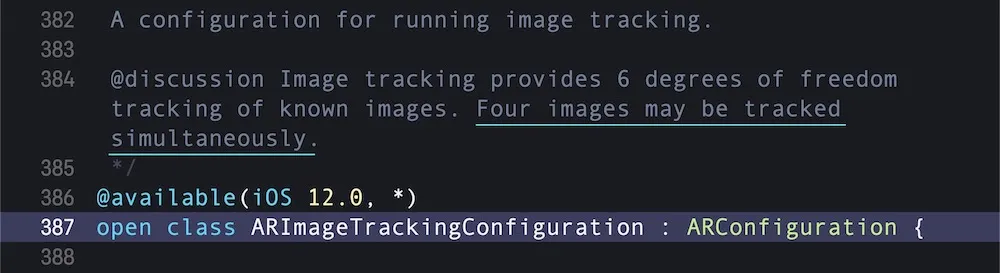

开箱即用,ARKit 一次最多只能跟踪 4 张图像(你可以"跟踪"多个标记,但同一时间只有 4 个可以生效)。关于此问题,请参考这个问题。

不过,我想知道是否有可能绕过此限制。比如说在计时器上添加和删除锚点,获取位置信息然后无需使用 ARKit 显示相应的模型等。我的 Swift 知识相当有限,所以尚未进行实验。有任何建议或指引,将会非常有帮助。

相比之下,Android 的 ARCore 根据文档最多可以支持 20 个。我也亲自测试过 Web 库在 iPhone 上跟踪超过 4 个标记。我还相信我曾在某个地方读到过某个 Nintendo DS 的变种能够跟踪多达 4 个以上的标记。由于硬件限制,这是不可行的。

相比之下,Android 的 ARCore 根据文档最多可以支持 20 个。我也亲自测试过 Web 库在 iPhone 上跟踪超过 4 个标记。我还相信我曾在某个地方读到过某个 Nintendo DS 的变种能够跟踪多达 4 个以上的标记。由于硬件限制,这是不可行的。