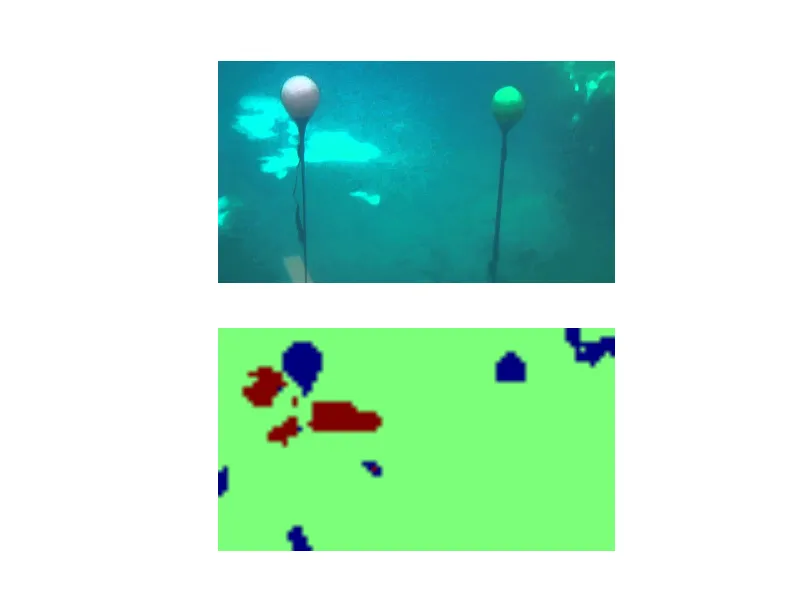

我正在尝试使用scikitlearn中的DBSCAN根据颜色对图像进行分割。结果如下 。可以看到有3个聚类。我的目标是将图片中的浮标分离到不同的簇中。但很明显它们都被归为同一簇。我已经尝试了各种eps值和min_samples,但这两个参数总是聚集在一起。我的代码如下:

。可以看到有3个聚类。我的目标是将图片中的浮标分离到不同的簇中。但很明显它们都被归为同一簇。我已经尝试了各种eps值和min_samples,但这两个参数总是聚集在一起。我的代码如下:

img= cv2.imread("buoy1.jpg)

labimg = cv2.cvtColor(img, cv2.COLOR_BGR2LAB)

n = 0

while(n<4):

labimg = cv2.pyrDown(labimg)

n = n+1

feature_image=np.reshape(labimg, [-1, 3])

rows, cols, chs = labimg.shape

db = DBSCAN(eps=5, min_samples=50, metric = 'euclidean',algorithm ='auto')

db.fit(feature_image)

labels = db.labels_

plt.figure(2)

plt.subplot(2, 1, 1)

plt.imshow(img)

plt.axis('off')

plt.subplot(2, 1, 2)

plt.imshow(np.reshape(labels, [rows, cols]))

plt.axis('off')

plt.show()

我猜测这是计算欧几里得距离,由于它在lab空间中,不同颜色之间的欧几里得距离将会不同。如果有人能给我指导,我会非常感激。

更新: 下面的答案可行。由于DBSCAN需要一个最多只有2个维度的数组,我将列连接到原始图像上并重塑为一个n x 5矩阵,其中n是x维度乘以y维度。这对我有效。

indices = np.dstack(np.indices(img.shape[:2]))

xycolors = np.concatenate((img, indices), axis=-1)

np.reshape(xycolors, [-1,5])