我正在使用AWS EC2深度学习AMI机器(Ubuntu 18.04.3 LTS(GNU / Linux 4.15.0-1054-aws x86_64v)),Python3(CUDA 10.1和Intel MKL)(Pytorch 1.3.1)从头开始训练vgg16模型,并在更新模型参数时遇到以下错误。

运行时错误:CUDA内存不足。 尝试分配24.00 MiB(GPU 0; 11.17 GiB总容量; 10.76 GiB已分配; 4.81 MiB空闲; 119.92 MiB缓存)

更新参数的代码:

def _update_fisher_params(self, current_ds, batch_size, num_batch):

dl = DataLoader(current_ds, batch_size, shuffle=True)

log_liklihoods = []

for i, (input, target) in enumerate(dl):

if i > num_batch:

break

output = F.log_softmax(self.model(input.cuda().float()), dim=1)

log_liklihoods.append(output[:, target])

log_likelihood = torch.cat(log_liklihoods).mean()

grad_log_liklihood = autograd.grad(log_likelihood, self.model.parameters())

_buff_param_names = [param[0].replace('.', '__') for param in self.model.named_parameters()]

for _buff_param_name, param in zip(_buff_param_names, grad_log_liklihood):

self.model.register_buffer(_buff_param_name+'_estimated_fisher', param.data.clone() ** 2)

调试后:log_liklihoods.append(output[:, target])这行代码在157次迭代后报错。

我有足够的内存,但它没有分配,我不明白为什么更新梯度会导致内存问题,因为每次迭代时梯度应该自动取消引用并释放。有什么想法吗?

我尝试了以下解决方案,但都没有成功。

- 降低批量大小

- 使用torch.cuda.empty_cache()释放缓存

- 减少滤波器数量以减少内存占用

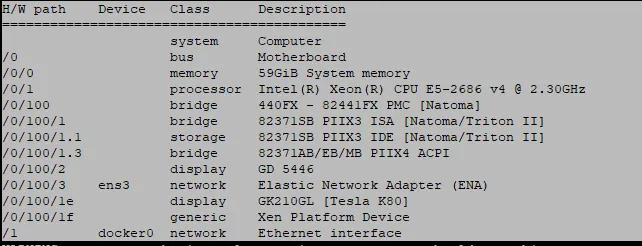

机器规格: