检测

SCNNode上的触摸需要不仅仅是在视图中添加

UITapGestureRecogniser。为了检测您触摸了哪个

SCNNode,您需要使用

SCNHitTest(与手势识别器结合使用),它是:

查找位于指定点或沿指定线段(或射线)的场景元素的过程。

SCNHitTest寻找:

沿着您指定的射线的SCNGeometry对象。对于射线和几何体之间的每个交点,SceneKit都会创建一个命中测试结果,以提供有关包含几何体的SCNNode对象和几何体表面交点的位置的信息。

好的,您可能会想,但这在我的情况下实际上是如何工作的?

嗯,让我们首先创建一个具有SCNSphere Geometry的SCNNode并将其添加到我们的场景中。

//1. Create An SCNNode With An SCNSphere Geometry

let nodeOneGeometry = SCNSphere(radius: 0.2)

//2. Set It's Colour To Cyan

nodeOneGeometry.firstMaterial?.diffuse.contents = UIColor.cyan

//3. Assign The Geometry To The Node

nodeOne = SCNNode(geometry: nodeOneGeometry)

//4. Assign A Name For Our Node

nodeOne.name = "Node One"

//5. Position It & Add It To Our ARSCNView

nodeOne.position = SCNVector3(0, 0, -1.5)

augmentedRealityView.scene.rootNode.addChildNode(nodeOne)

你会注意到,在这里我给我们的SCNNode分配了一个名称,这使得跟踪它变得更加容易(例如通过hitTest进行识别)。

现在我们已经将SCNNode添加到层次结构中,让我们创建一个UITapGestureRecognizer,像这样:

//1. Create A UITapGestureRecognizer & Add It To Our MainView

let tapGesture = UITapGestureRecognizer(target: self, action: #selector(checkNodeHit(_:)))

tapGesture.numberOfTapsRequired = 1

self.view.addGestureRecognizer(tapGesture)

现在我们已经设置好了所有内容,我们需要创建一个checkNodeHit函数来检测用户点击的节点是哪个:

@objc func checkNodeHit(_ gesture: UITapGestureRecognizer){

let currentTouchLocation = gesture.location(in: self.augmentedRealityView)

guard let hitTestNode = self.augmentedRealityView.hitTest(currentTouchLocation, options: nil).first?.node else { return }

if hitTestNode.name == "Node One"{

print("The User Has Successfuly Tapped On \(hitTestNode.name!)")

}

}

现在,如果您想要在用户点击的位置放置一个SCNNode,则必须使用ARSCNHitTest来提供此功能,它提供了:

通过检查AR会话中设备摄像机视图中的点发现的有关真实世界表面的信息。

通过执行此操作,我们随后可以使用结果的worldTransform属性在该位置放置虚拟内容。

供您参考,worldTransform是:

命中测试结果相对于世界坐标系的位置和方向。

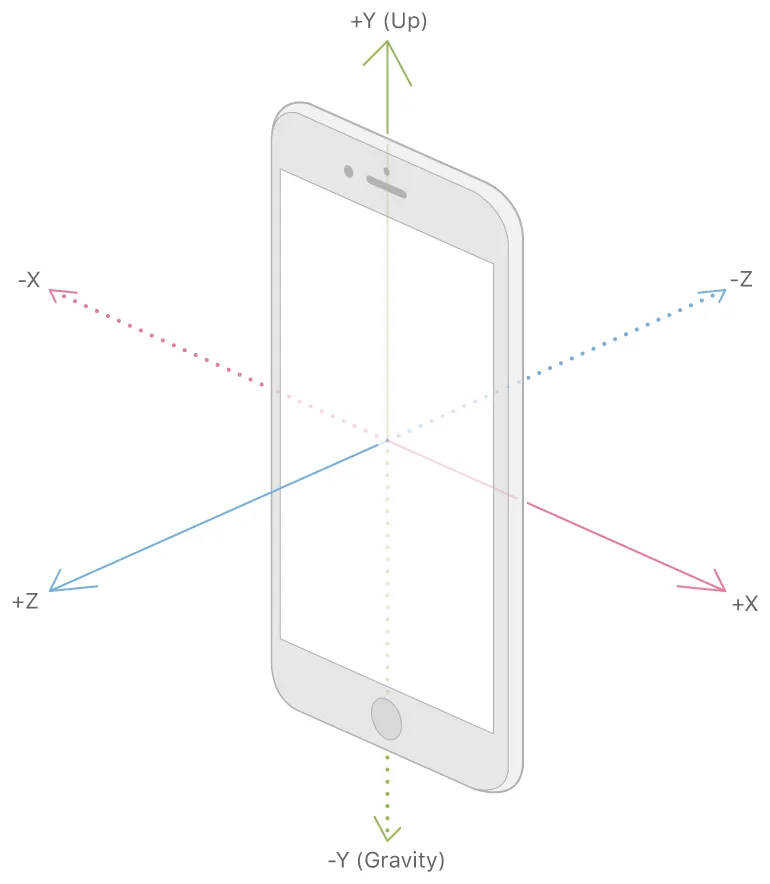

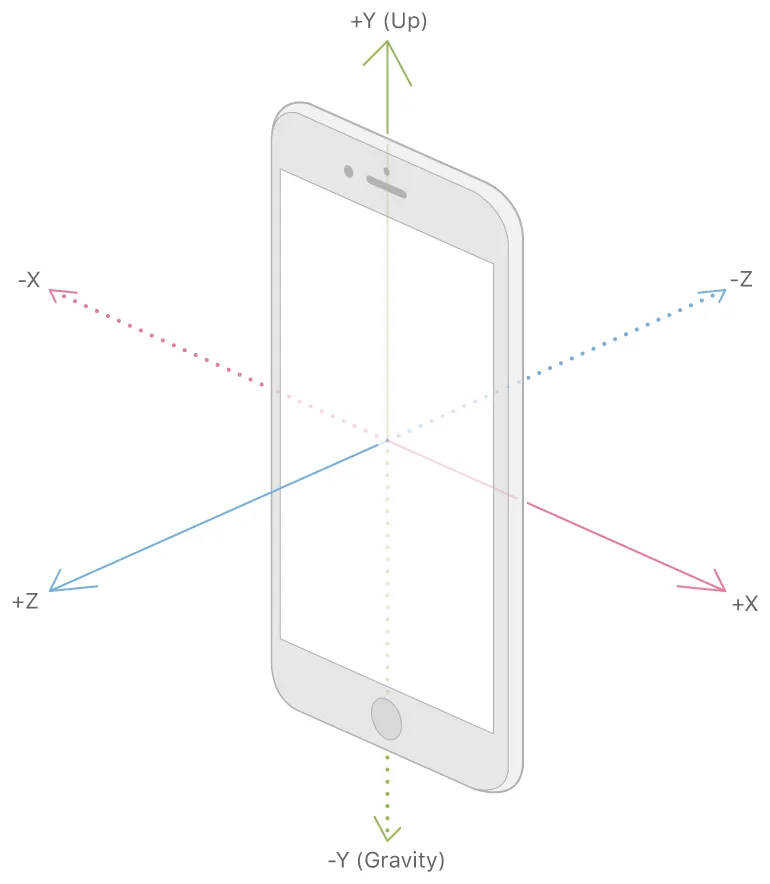

在ARKit中定位可以轻松地进行可视化处理,如下所示:

让我们再次看一下如何使用它来放置虚拟对象:

override func touchesBegan(_ touches: Set<UITouch>, with event: UIEvent?) {

guard let currentTouchLocation = touches.first?.location(in: self.augmentedRealityView),

let hitTest = self.augmentedRealityView.hitTest(currentTouchLocation, types: .featurePoint).first else { return }

let worldPositionFromTouch = hitTest.worldTransform.columns.3

let boxNode = SCNNode()

let boxGeometry = SCNBox(width: 0.1, height: 0.1, length: 0.1, chamferRadius: 0)

boxGeometry.firstMaterial?.diffuse.contents = UIColor.cyan

boxNode.geometry = boxGeometry

boxNode.position = SCNVector3(worldPositionFromTouch.x, worldPositionFromTouch.y, worldPositionFromTouch.z)

self.augmentedRealityView.scene.rootNode.addChildNode(boxNode)

}

希望它有所帮助...