我正在关注由Skipper Seabold介绍的Pandas和Scikit learn的优秀演讲。

我正在使用他来自UCI成年人名字的清理过的数据集。

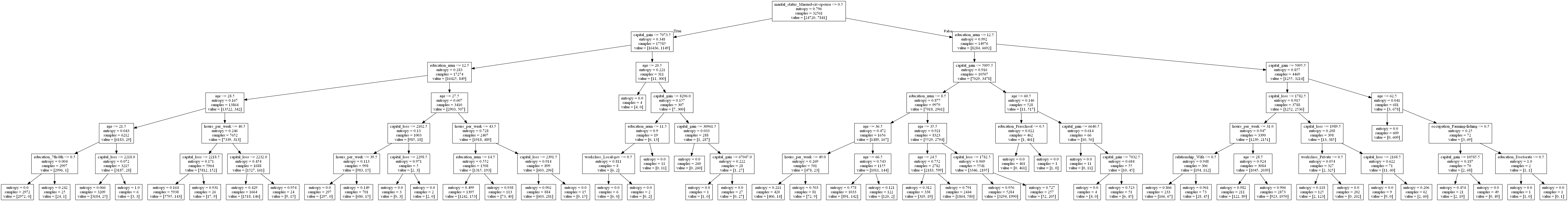

运行此代码并通过graphviz生成树形图像后,我们可以观察到每个节点上都有值数据。

我正在使用他来自UCI成年人名字的清理过的数据集。

运行此代码并通过graphviz生成树形图像后,我们可以观察到每个节点上都有值数据。

import pandas as pd

from sklearn.tree import DecisionTreeClassifier, export_graphviz

dta = pd.read_csv("data/adult.data.cleaned.csv")

for col in dta:

if not dta[col].dtype.kind == "O":

continue

if dta[col].str.contains("\?").any():

dta.ix[dta[col].str.contains("\?"), col] = "Other"

test.ix[test[col].str.contains("\?"), col] = "Other"

dta.income.replace({"<=50K": 0, ">50K": 1}, inplace=True)

test.income.replace({"<=50K": 0, ">50K": 1}, inplace=True)

y = dta.pop("income")

y_test = test.pop("income")

X_train = pd.get_dummies(dta)

X_test = pd.get_dummies(test)

X_test[X_train.columns.difference(X_test.columns)[0]] = 0

dtree = DecisionTreeClassifier(criterion='entropy', random_state=0, max_depth=6)

dtree.fit(X_train, y)

export_graphviz(dtree, feature_names=X_train.columns)

value=[x, y]属性。