我正在尝试找到一种易于实现的解决方案来使用OpenCV的OCR算法。我对图像处理非常新手!我正在使用RLE算法解码特定编解码器的视频。

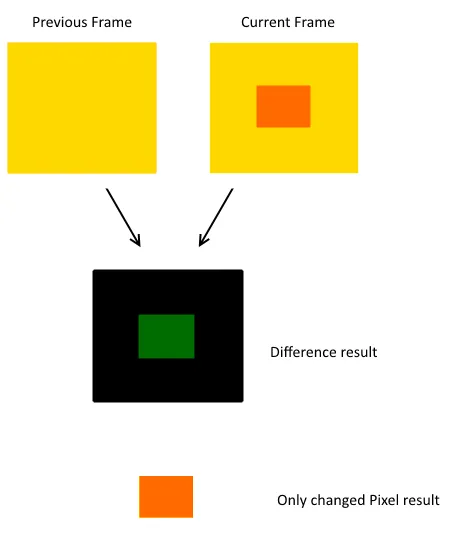

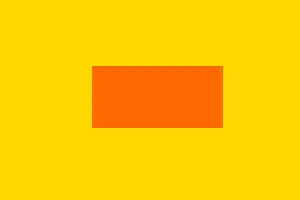

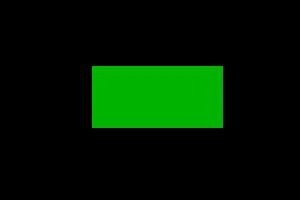

我的目标是,对于每个解码帧,我想将其与前一个帧进行比较,并存储在两个帧之间发生变化的像素。大多数现有解决方案会给出两个帧之间的差异,但我只想保留已更改的新像素并将其存储在表中,然后能够分析每组已更改的像素,而不是每次分析整个图像。

我计划使用“斑点检测”算法,但在实现之前卡住了。

今天,我正在尝试这样做:

我的目标是,对于每个解码帧,我想将其与前一个帧进行比较,并存储在两个帧之间发生变化的像素。大多数现有解决方案会给出两个帧之间的差异,但我只想保留已更改的新像素并将其存储在表中,然后能够分析每组已更改的像素,而不是每次分析整个图像。

我计划使用“斑点检测”算法,但在实现之前卡住了。

今天,我正在尝试这样做:

char *prevFrame;

char *curFrame;

QVector DiffPixel<LONG>;

//for each frame

DiffPixel.push_back(curFrame-prevFrame);

我真的想要一个“仅更改像素结果”的解决方案。是否有人可以给我一些提示或纠正我是否走错了路?

编辑:

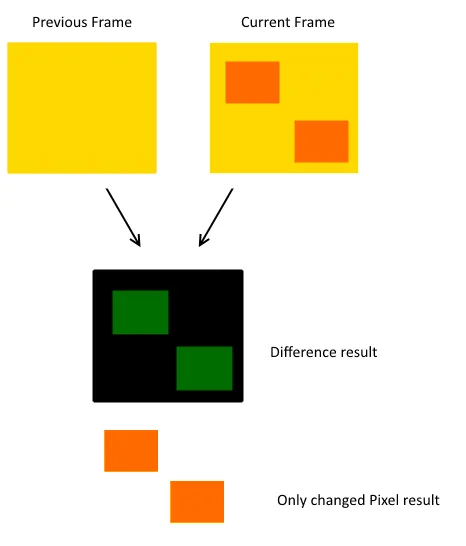

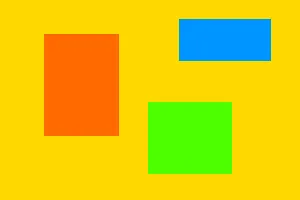

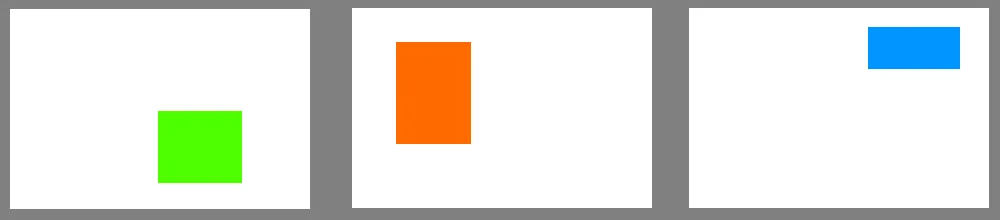

新问题,如果有多个更改像素区域,那么每个更改像素块是否可能有一个表格,还是只有一个唯一的表格?以下面的例子为例:

最好的结果是有两个mat矩阵。第一个矩阵带有第一个橙色正方形,第二个矩阵带有第二个橙色正方形。这样,如果我们只在一个矩阵中存储结果,分辨率几乎与整个画面相同,就避免了“扫描”几乎整个画面。

这里的主要目标是将需要分析以查找文本的区域(即分辨率)最小化。