更新: 这个问题与Google Colab的“笔记本设置:硬件加速器:GPU”有关。这个问题是在“TPU”选项添加之前编写的。

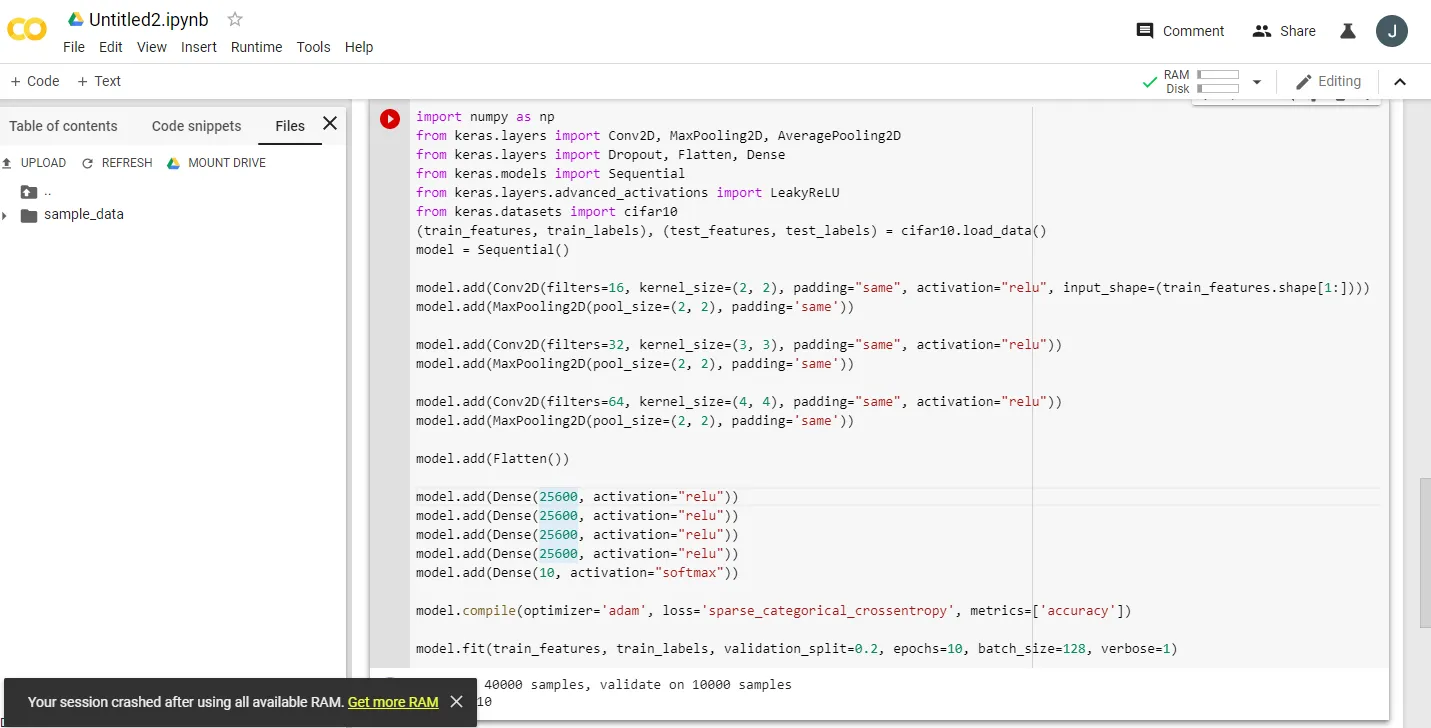

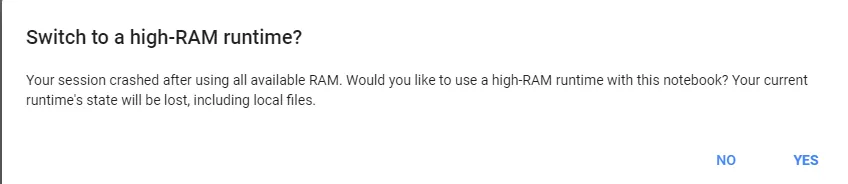

看到多个激动人心的消息,称Google Colaboratory提供免费的Tesla K80 GPU,我尝试在上面运行fast.ai课程,但它从未完成——很快就会耗尽内存。我开始调查为什么。

底线是,“免费的Tesla K80”并不是对所有人都是“免费”的——对于一些人来说,只有一小部分是“免费的”。

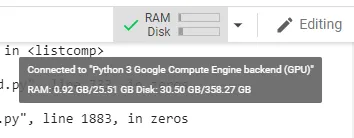

我从加拿大西海岸连接到Google Colab,我只获得了0.5GB的GPU RAM,而其他用户可以访问11GB的GPU RAM。

显然,0.5GB的GPU RAM对于大多数ML/DL工作是不足够的。

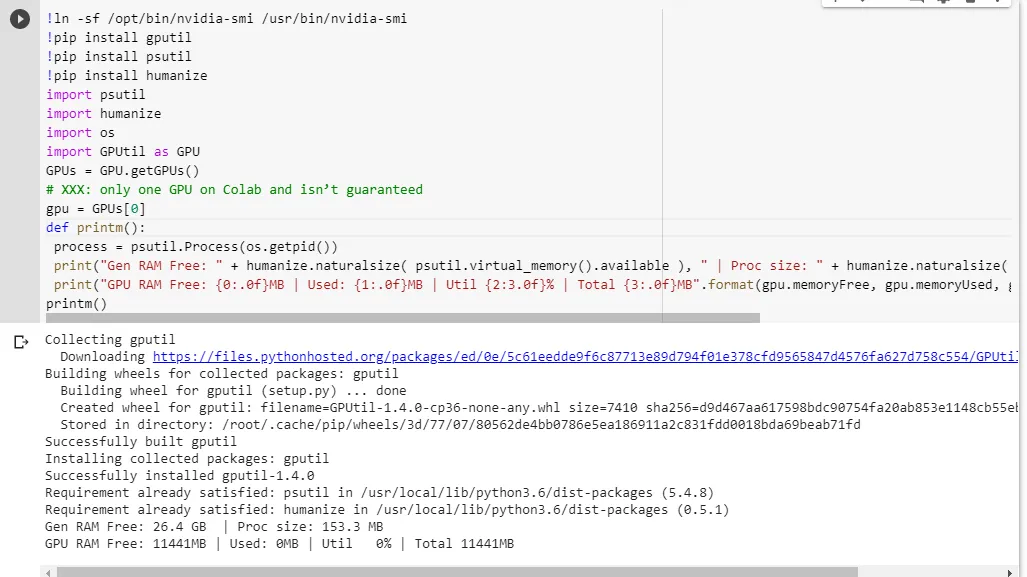

如果您不确定自己获得了什么,这里有一个小调试函数(仅适用于笔记本的GPU设置):

# memory footprint support libraries/code

!ln -sf /opt/bin/nvidia-smi /usr/bin/nvidia-smi

!pip install gputil

!pip install psutil

!pip install humanize

import psutil

import humanize

import os

import GPUtil as GPU

GPUs = GPU.getGPUs()

# XXX: only one GPU on Colab and isn’t guaranteed

gpu = GPUs[0]

def printm():

process = psutil.Process(os.getpid())

print("Gen RAM Free: " + humanize.naturalsize( psutil.virtual_memory().available ), " | Proc size: " + humanize.naturalsize( process.memory_info().rss))

print("GPU RAM Free: {0:.0f}MB | Used: {1:.0f}MB | Util {2:3.0f}% | Total {3:.0f}MB".format(gpu.memoryFree, gpu.memoryUsed, gpu.memoryUtil*100, gpu.memoryTotal))

printm()

在运行任何其他代码之前,在jupyter笔记本中执行它会给我:

Gen RAM Free: 11.6 GB | Proc size: 666.0 MB

GPU RAM Free: 566MB | Used: 10873MB | Util 95% | Total 11439MB

获得完整卡片访问权限的幸运用户将看到:

Gen RAM Free: 11.6 GB | Proc size: 666.0 MB

GPU RAM Free: 11439MB | Used: 0MB | Util 0% | Total 11439MB

你从GPUtil中借鉴的GPU RAM可用性计算中是否存在任何缺陷?

如果您在Google Colab笔记本上运行此代码,能否确认您获得类似的结果?

如果我的计算是正确的,有没有办法在免费的计算机上获取更多的GPU RAM?

更新:我不确定为什么我们中的一些人只能获得其他用户的1/20。例如,帮助我调试的人来自印度,他可以获得全部内容!

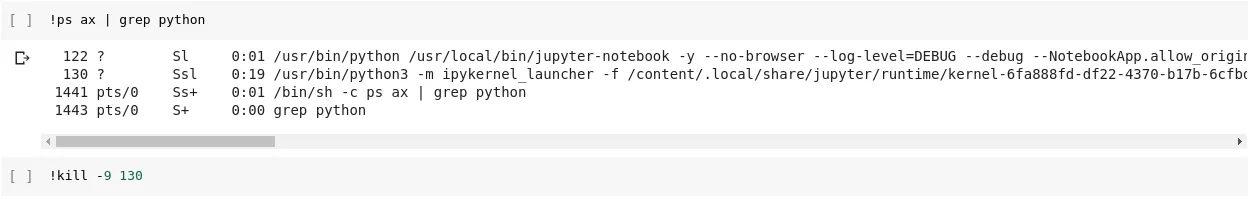

注意:请不要再发送关于如何杀死可能被卡住/失控/并行的笔记本电脑的建议。无论如何,如果您和我处于同样的困境,并运行调试代码,则仍将获得总共5%的GPU RAM(截至此更新仍然是这样)。

gpu_options=tf.GPUOptions(per_process_gpu_memory_fraction=1)和sess = tf.Session(config=tf.ConfigProto(gpu_options=gpu_options)。 - user3731622