我正在制作一个使用OpenCV(2.43) ORB追踪特征的程序。我遵循了这个教程,并使用了这里的建议。

我的目标是在视频中追踪物体(人脸)并在其周围画一个矩形。

我的程序能够正确地找到关键点并将它们匹配。但是当我尝试使用

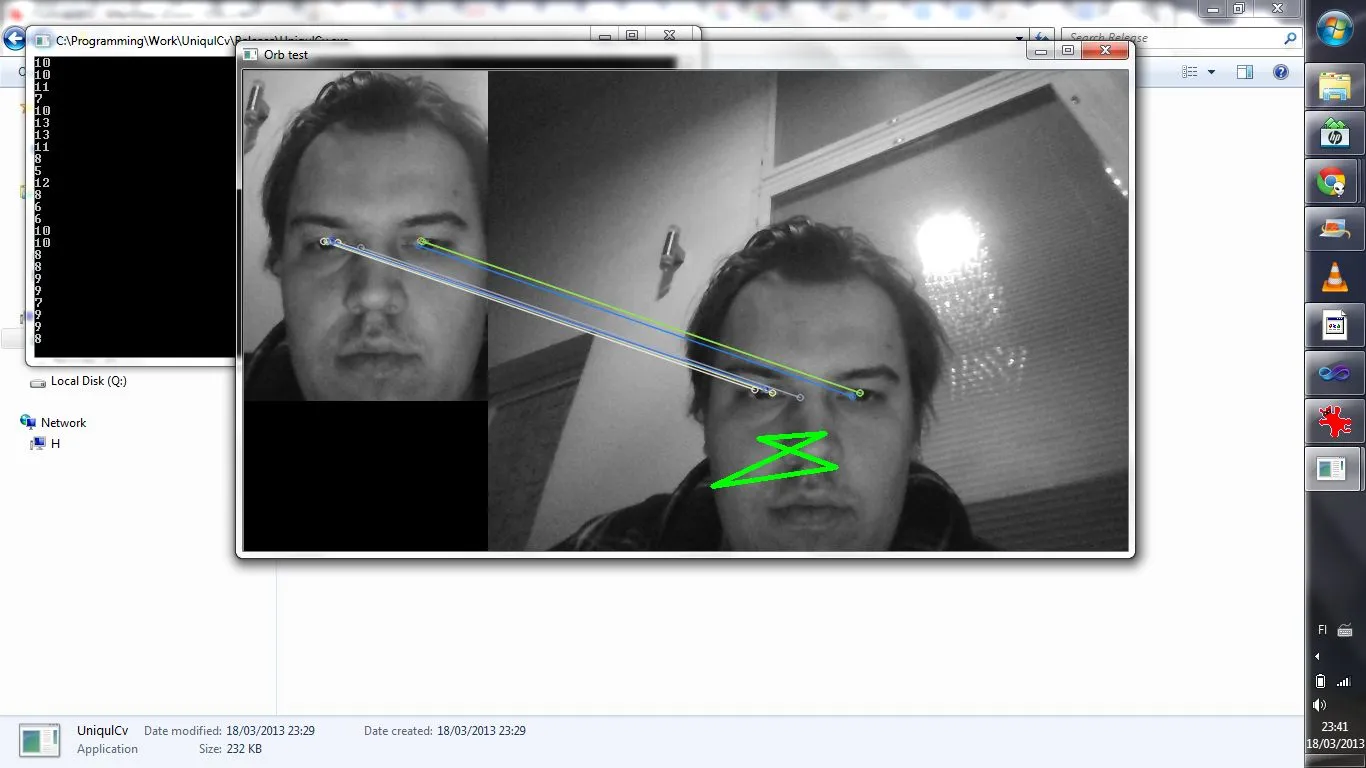

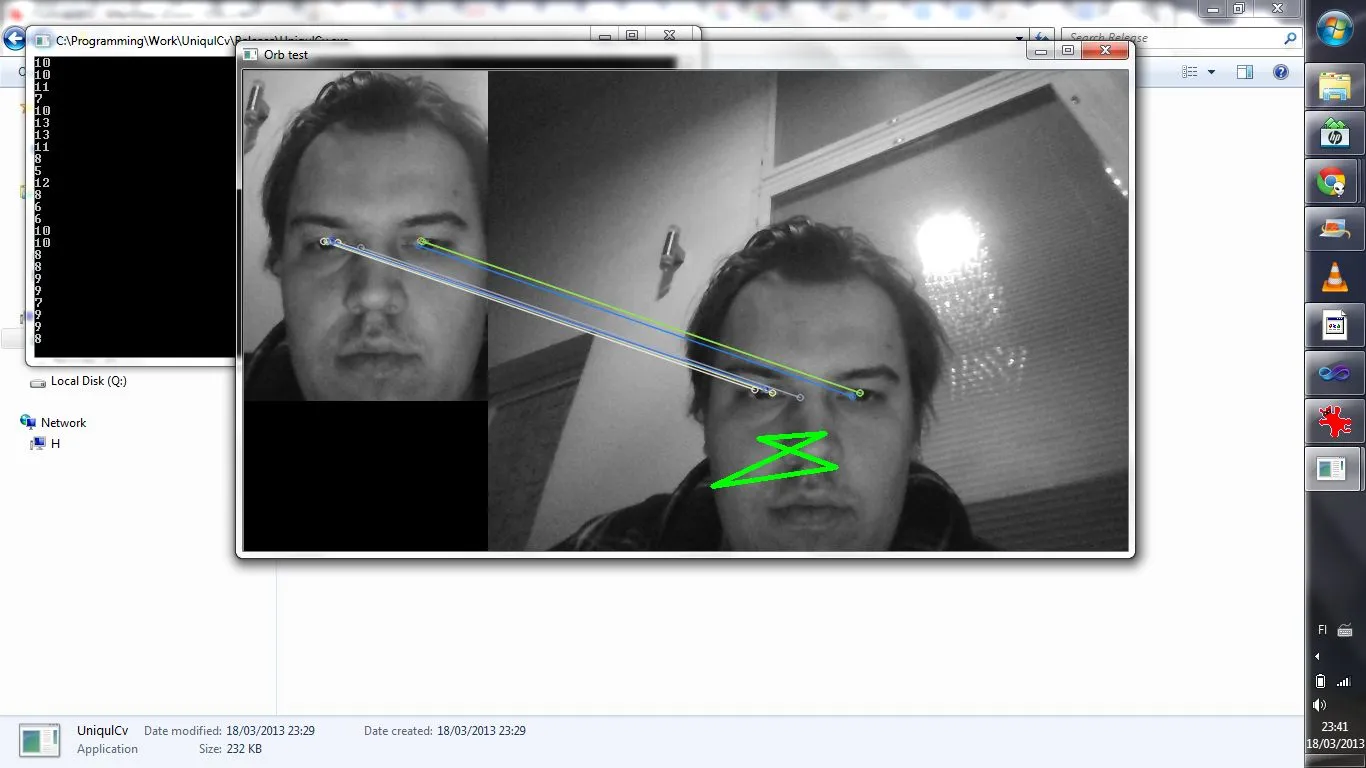

以下是一个示例图片: 以下是相关的问题部分:

以下是相关的问题部分:

我的目标是在视频中追踪物体(人脸)并在其周围画一个矩形。

我的程序能够正确地找到关键点并将它们匹配。但是当我尝试使用

findHomography+perspectiveTransform来查找图像的新角落时,通常会返回一些无意义的值(尽管有时会返回正确的单应性矩阵)。以下是一个示例图片:

以下是相关的问题部分:

以下是相关的问题部分:Mat H = findHomography( obj, scene, CV_RANSAC );

//-- Get the corners from the image_1 ( the object to be "detected" )

std::vector<Point2f> obj_corners(4);

obj_corners[0] = cvPoint(0,0); obj_corners[1] = cvPoint( img_object.cols, 0 );

obj_corners[2] = cvPoint( img_object.cols, img_object.rows ); obj_corners[3] = cvPoint( 0, img_object.rows );

std::vector<Point2f> scene_corners(4);

perspectiveTransform( obj_corners, scene_corners, H);

//-- Draw lines between the corners (the mapped object in the scene - image_2 )

line( img_matches, scene_corners[0] + Point2f( img_object.cols, 0), scene_corners[1] + Point2f( img_object.cols, 0), Scalar(0, 255, 0), 4 );

line( img_matches, scene_corners[1] + Point2f( img_object.cols, 0), scene_corners[2] + Point2f( img_object.cols, 0), Scalar( 0, 255, 0), 4 );

line( img_matches, scene_corners[2] + Point2f( img_object.cols, 0), scene_corners[3] + Point2f( img_object.cols, 0), Scalar( 0, 255, 0), 4 );

line( img_matches, scene_corners[3] + Point2f( img_object.cols, 0), scene_corners[0] + Point2f( img_object.cols, 0), Scalar( 0, 255, 0), 4 );

余下的代码实际上与我提供的链接中的代码几乎相同。所绘制的线条完全随机,我的目标只是在新场景中获得源对象的最小矩形,因此如果有其他替代方法可以使用,也可以起到作用。

P.S. 要跟踪的源图像是从视频输入中复制的区域,然后在来自该输入的新图片中进行跟踪,这会有影响吗?