我已经实现了一个多层感知器来预测输入向量的正弦值。向量由四个随机选择的-1、0、1组成,并且有一个偏置设置为1。该网络应该预测向量内容总和的正弦值。

例如,输入=<0,1,-1,0,1> 输出= Sin(0+1+(-1)+0+1)

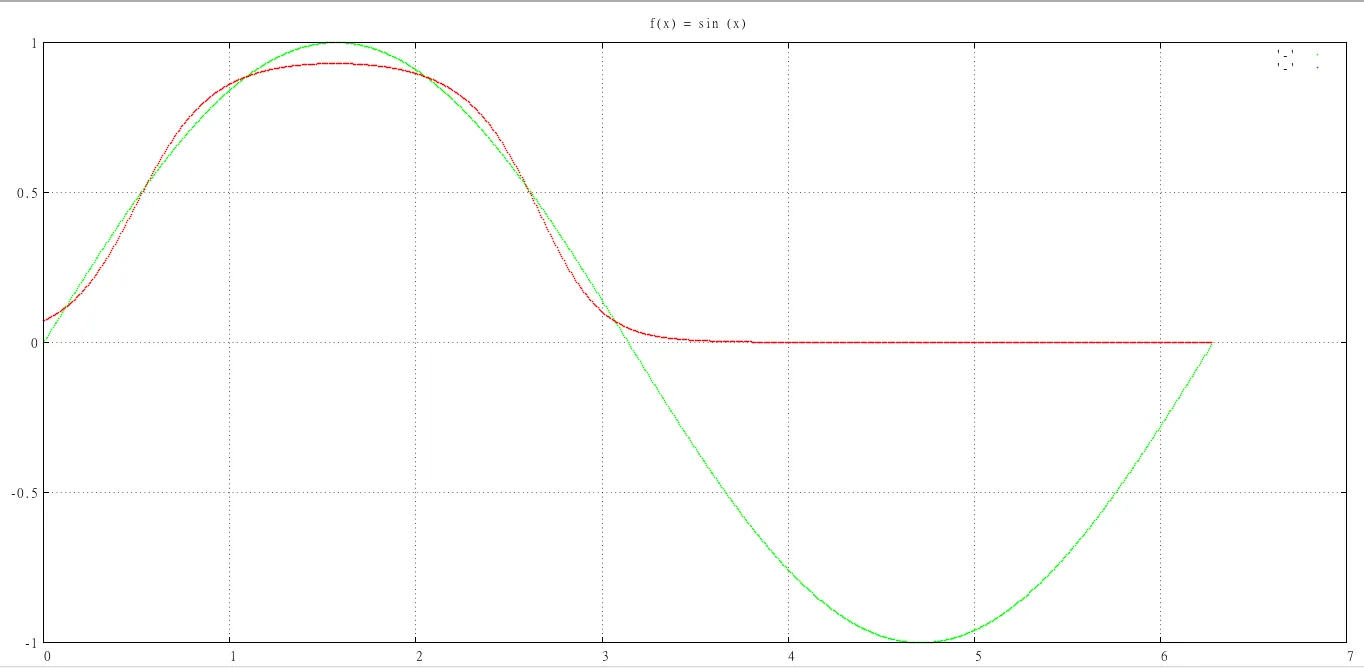

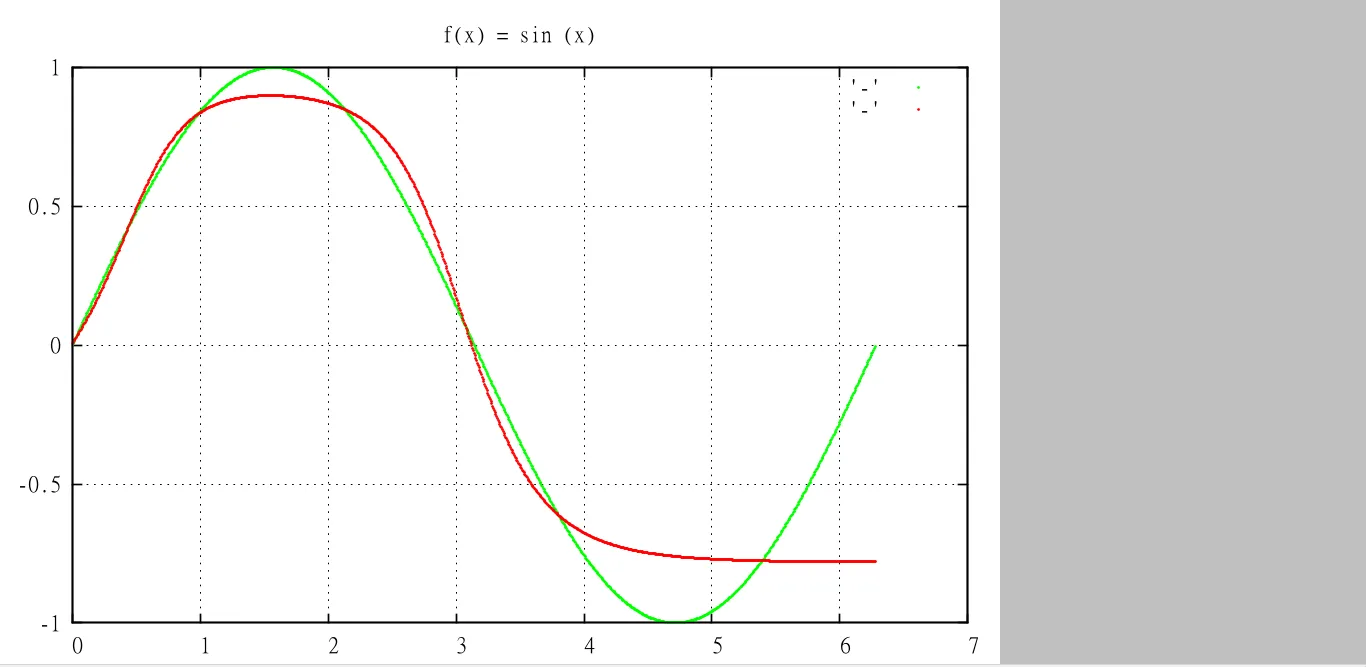

我面临的问题是,该网络永远不会预测负值,并且许多向量的正弦值为负数。它完美地预测所有非负输出。我认为权重更新存在问题,这些权重在每个周期后更新。是否有人遇到过神经网络的这个问题?任何帮助都将是很好的!

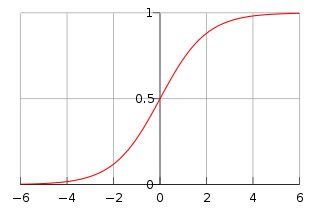

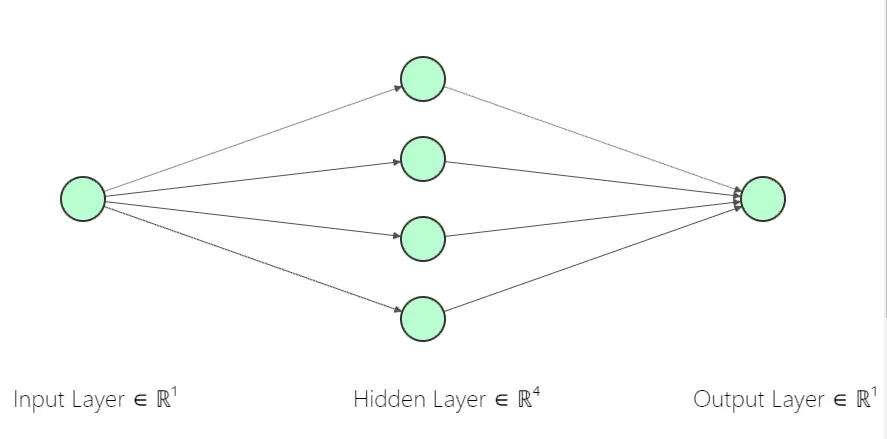

注:该网络有5个输入,在1个隐藏层中有6个隐藏单元和1个输出。我在激活隐藏层和输出层时使用sigmoid函数,并尝试了大量的学习速率(目前为0.1)。