我注意到LSH似乎是一种寻找高维属性相似项的好方法。

在阅读了http://www.slaney.org/malcolm/yahoo/Slaney2008-LSHTutorial.pdf这篇论文之后,我仍然对其中的公式感到困惑。

是否有人知道一篇博客或文章可以用简单的方式解释LSH?

我注意到LSH似乎是一种寻找高维属性相似项的好方法。

在阅读了http://www.slaney.org/malcolm/yahoo/Slaney2008-LSHTutorial.pdf这篇论文之后,我仍然对其中的公式感到困惑。

是否有人知道一篇博客或文章可以用简单的方式解释LSH?

我在这里用Python写了一些示例代码(仅50行),该代码使用余弦相似性。 https://gist.github.com/94a3d425009be0f94751

基于向量空间的推文可以成为高维数据的一个很好的例子。

请查看我的博客文章,了解如何应用局部敏感哈希技术来查找相似的推文。

http://micvog.com/2013/09/08/storm-first-story-detection/

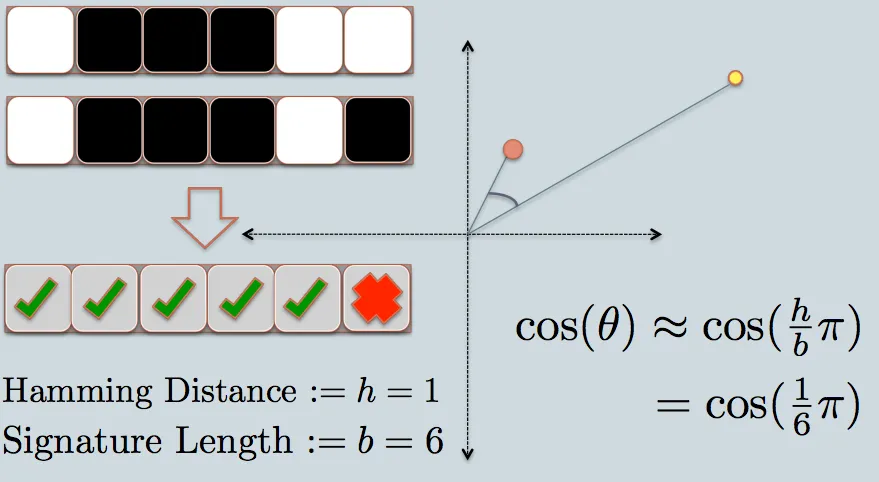

并且因为一张图片胜过千言万语,请查看下面的图片:

http://micvog.files.wordpress.com/2013/08/lsh1.png

http://micvog.files.wordpress.com/2013/08/lsh1.png

希望这有所帮助。 @mvogiatzis

这是一份来自斯坦福大学的演示文稿,介绍了相关的技术知识。我觉得它对我很有帮助。第二部分更多地涉及到 LSH,但第一部分也有相关内容。

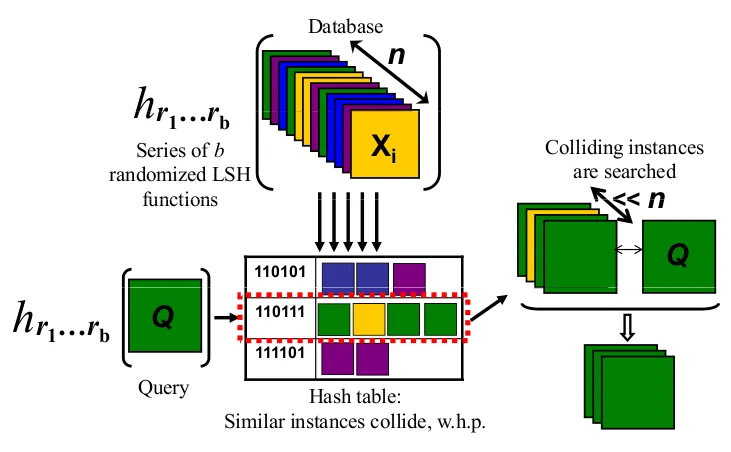

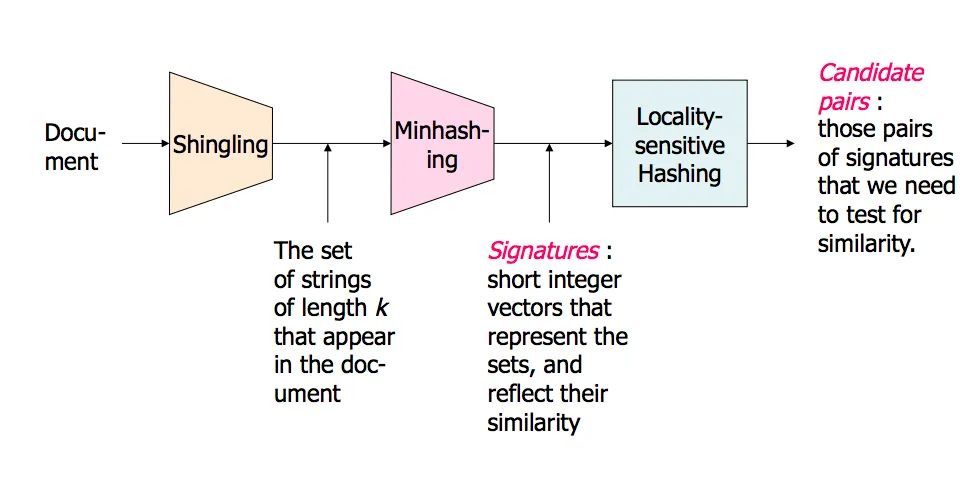

以下是概述图片(幻灯片中还有更多):

高维数据的最近邻搜索 - 第1部分: http://www.stanford.edu/class/cs345a/slides/04-highdim.pdf

高维数据的最近邻搜索 - 第2部分: http://www.stanford.edu/class/cs345a/slides/05-LSH.pdf

需要强调的是,不同的相似性度量有不同的LSH实现方式。

在我的博客中,我尝试深入解释了针对minHashing(jaccard相似度度量)和simHashing(cosine距离度量)情况下的LSH。希望对您有所帮助: https://aerodatablog.wordpress.com/2017/11/29/locality-sensitive-hashing-lsh/